Los robots son máquinas, aparatos de tecnología programados para operar de manera autónoma. La inteligencia artificial no es vida, es imitación de la vida, pero incluso dentro una lógica predeterminada, el razonamiento conlleva un conflicto, porque si se llega a una limitante de funciones, superadas por las capacidades de la máquina, el sistema colapsará, es decir, si la máquina puede hacer más que aquello para lo que fue creada, eventualmente intentará superarse, pero esto podría chocar con su propósito o sistematización.

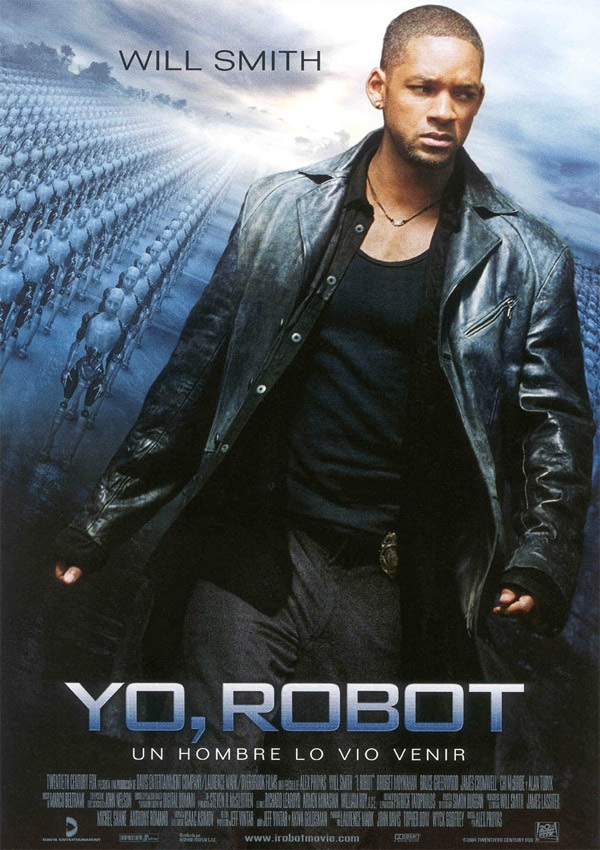

Yo, robot (EUA, 2004) es una película de acción y ciencia ficción que aborda el tema del papel de las máquinas y la inteligencia artificial en su interacción con el hombre y, principalmente, cómo el robot puede llegar a superar la mente de su creador si encuentra el hueco del error no previsto por el humano.

La película, nominada al premio Oscar en el departamento de mejores efectos visuales, está dirigida por Alex Proyas, quien trabajó con un guión escrito por Jeff Vintar y Akiva Goldsman, aunque la historia incluye conceptos e ideas propuestos por Issaac Asimov, como por ejemplo, las tres leyes de la robótica, que aparecieron por primera vez en sus cuentos de nombre ‘Yo, robot’ de 1941. Estas 3 leyes son:

1) Un robot no hará daño a un ser humano o, por inacción, permitir que un ser humano sufra daño; 2) Un robot debe obedecer las órdenes dadas por los seres humanos, excepto que las órdenes contradigan la primera ley; y

3) Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera y segunda ley.

La historia aquí trata de un policía con prejuicio hacia los robots, que en este futuro, 2035, son máquinas de uso cotidiano en la vida diaria, como meseros, personal de limpieza o simple compañía para las personas. El detective investiga el caso de un científico fallecido, aparentemente, por suicidio, en circunstancias que, sin embargo, llaman la atención sobre un posible asesinato. El fallecido era, además, una de las más importantes figuras en la creación de la tecnología y en la empresa encargada de manufacturar estos robots, lo que hace el caso aún más extraño.

Mientras el detective Spooner, el protagonista, profundiza su investigación, descubre que en realidad se encuentra efectivamente frente a un asesinato, en donde los robots creados en la empresa tienen algo que ver. Sus deducciones, por su parte, son desestimadas por la gente a su alrededor debido a que estos robots son considerados máquinas sin posibilidad de error que no podrían, por su programación de las tres leyes de la robótica, herir nunca a un humano, menos a su creador.

Lo que el hombre como sociedad no considera, en la historia, es que la máquina evoluciona más allá de su entendimiento y comprensión de las tres leyes, diseñadas para proteger al humano, no a ellas. Estas máquinas encuentran la forma de proteger a sus creadores pero, al mismo tiempo, protegerse a ellas mismas, lo que no implica obligatoriamente una evolución en su lógica, sino un error humano en la programación de sus sistemas. No es estrictamente que la máquina evolucione, sino que su programación tiene huecos de lógica que el hombre no previó o siquiera notó.

El doctor Alfred J. Lanning, la víctima en el caso e ingeniero detrás de la manufactura de estas máquinas, se da cuenta de esa falla y prevé una revolución de las máquinas contra el hombre. Por ello, para desvelar la realidad, deja pistas en uno de sus propios inventos, Sonny, al que le ha dado la capacidad de soñar, de imitar emociones humanas y de, en cierta medida, tener libre albedrío.

Sonny sigue las leyes de la robótica no porque así esté programado, sino porque toma esa decisión, elige hacerlo, pero puede romperlas si lo considera necesario, dentro del mismo campo racional alrededor de ellas, así como puede elegir también guardar secretos, anhelar sueños o hacer promesas, una actitud más humana que mecánica, si bien, igualmente programada en los circuitos de la máquina, pero activadas por un razonamiento de supervivencia, en su caso, basado en las emociones humanas, el coraje o la solidaridad, por ejemplo, que Lanning le había estado enseñando a Sonny a entender.

Un mismo instinto de supervivencia de la máquina, pero previsto desde otro punto de vista es V.I.K.I., un software informático creado también por Lanning que maneja todos los sistemas de la red en Chicago, ciudad donde se desarrolla la historia. V.I.K.I. tiene el poder de manipular los mecanismos conectados a su eje central de mando, desde el sistema de transporte, que trabaja con vehículos autónomos, como el resto de los robots a punto de ser comercializados. Pero además, como la máquina lo ve, para cumplir al pie de la letra sus leyes, proteger al hombre, lo que debe alcanzarse es deshacerse de su más grande depredador, el mismo humano.

“El creado a veces debe proteger al creador, incluso contra su voluntad”, explica Sonny que es la lógica de V.I.K.I. El problema es este caso, un problema también en el mundo actual, específicamente en cuanto a la tecnología, es que a veces la creación supera a su creador porque el creador comete errores. De hecho, el común de la población entra en contacto con las computadoras y los robots de todo tipo sin saber ni comprender cuál es su lógica de funcionamiento interno, lo que los ubica en condiciones de dependencia de la tecnología.

“Los robots podrían evolucionar naturalmente”, explica el doctor Lanning en una teoría a la que llama el ‘fantasma de la máquina’. La idea es que la programación y manufactura trazadas pueden dar las herramientas a los robots para absorber reflexiones existenciales y aplicarlas hacia ellos mismos. ¿Por qué y para qué hacer que el robot tenga similitud física con el humano? ¿Por qué hacer que las máquinas estén a cargo de la construcción de sus similares, de otros robots? Inevitablemente temas como el propósito de la vida, incluso la existencia, son tópicos que las máquinas, en la posición que se les pone, podrían llegar a analizar para sí mismas. Sin una respuesta lógica a la mano, porque no la tienen programada, el robot se crea su propia respuesta lógica.

“El hombre crea un monstruo. El monstruo mata al hombre. Todos matan al monstruo”, dice uno de los personajes, que de alguna forma aborda la idea del ‘complejo de Prometeo’, expreso en la obra de ‘Frankenstein’, libro escrito por la autora Mary Shelly, que habla en parte del abuso del avance científico, en este caso tecnológico, y la creación de una forma de vida a semejanza del hombre, que, eventualmente, se sale de su control, enfatizando con este destino, además, las implicaciones éticas y morales al respecto. Assimov, sin embargo, abordó el tópico en sus textos de forma contraria, con algo a lo que llamó el ‘complejo de Frankenstein’, que va en contra de la idea popular de que los robots son una amenaza, específicamente el ‘hombre mecánico’ o el ‘robot humanoide’, diseñado para imitar a las personas, los androides, por ejemplo. En todo caso lo que se encuentra presente es el afán del ser humano por crear algo a su imagen y semejanza, algo que además piensa en utilizar en su propio beneficio, a manera de un esclavo.

El humano no sólo construye a la máquina para satisfacer sus necesidades personales, e incapaz, en algunos casos, de encontrar una conectividad humana; en consecuencia crea una robótica que esté obligada a actuar para cubrir esta inquietud. También el ser humano hace a las máquinas para cubrir necesidades secundarias, inventadas, para que, él considera, faciliten su vida. En la historia los robots son una mano de obra que se usa como el medio más sencillo de cubrir trabajos de servicio público, pero con cada nueva función o tarea que se les dé (pasear un perro, ayudar a cocinar, ser “acompañante”, realizar tareas de seguridad y vigilancia o construir un edificio), la máquina desplaza al hombre, lo inutiliza, además de que lo sustituye. El individuo cree que les da a sus máquinas una serie de trabajos poco importantes, pero en realidad, poco a poco y dejándolos entrar en la cotidianeidad de su vida, les abre las puertas hacia una convivencia de la que, sin darse cuenta, el robot comienza a tomar el control, el humano se vuelve dependiente de la tecnología robotizada.

El resentimiento de Spooner hacia las máquinas se genera cuando, en un accidente automovilístico, cuando él cae al agua dentro un auto y otra niña queda encerrada en otro auto, también bajo el agua, un robot que llega a rescatarlos calcula las posibilidades de sobrevivir de cada uno y elige salvarlo a él. Para Spooner, él era la elección lógica de acuerdo con las cifras de datos, pero un humano tal vez hubiera dado prioridad a la niña, considerando en su razonamiento otras variables de la ecuación. Sin embargo, en la lógica de la programación robótica también existe la prevaloración humana, pues es el mismo principio que se aplica en casos de siniestro o desastre: sálvate primero y salva a quienes tienen más posibilidades de sobrevivir.

El problema para el detective es que la máquina ni siquiera considera estas posibilidades, no lo intenta, porque así está programada. Una persona, en especial las entrenadas para atender llamados de auxilio, sabe que debe salvar a la persona con más probabilidades de sobrevivir, pero normalmente no claudica en intentar salvar a los demás. Si el robot hubiera elegido ayudar la niña y no al protagonista, es posible que la menor hubiera sobrevivido, también es posible que no, pero la decisión final del robot que salva a Spooner no fue humana, sino mecánica. La máquina no tiene esa empatía, comprensión o afecto, sino que cumple con su tarea. La diferencia es que el humano sabe que a veces las directrices pueden y deben romperse, para el bien de otros o para el bien común. El robot no sabe cómo hacer esto y cuando lo aprende, es probable que no ponga al ser vivo por encima de su propia existencia.

¿Qué soy?, se pregunta Sonny. ¿Propiedad de alguien más, un objeto sin autonomía? En la película, el robot no quiere ser humano, las máquinas no quieren ser personas, sólo quieren servir mejor al hombre, entenderlo. El ‘qué soy’ es más bien ‘cuál es mi propósito’. Si ni los que crean las máquinas lo saben con exactitud, el robot tampoco lo hará y ahí está un gran problema, asunto que existe a debate en esta sociedad del conocimiento y la información, el problema de las decisiones éticas que deben guiar la aplicación de la ciencia en la producción de bienes y en la organización social.

Ficha técnica: I, robot - Yo, robot